Mengangumkan. Dua orang peneliti AI (artificial intelligence) meraih penghargaan Nobel 2024 bidang fisika. Mereka adalah Hopfield dan Hinton.

Saya gembira mendengar beritu itu: penelitian AI mendapat hadiah Nobel; dan saya terkejut heran apa hubungan AI dengan Nobel fisika? Biasanya, setelah penghargaan Nobel, sebagai tema pemenang Nobel, tema AI akan makin ramai menjadi pembahasan publik. Sehingga, kita makin memahami AI. Di berbagai kesempatan, saya sering mengingatkan resiko besar dari AI; tentu, AI juga memberi manfaat.

Saya menyebut narasi AI analog dengan narasi rokok dan ganja; dari aspek bahayanya. Meskipun, Nolan, sutradara Oppenheimer, menyatakan bahwa AI lebih bahaya dari bom atom. Untungnya, saya punya teman yang baik. Dia mengatakan narasi AI mirip dengan air bening yang menyehatkan. Tentu saja, air juga bisa menenggelamkan manusia; tetapi, itu salah manusianya sendiri.

1. Penghargaan Nobel 2024

2. Dari Fisika sampai AI

3. Bapak AI Menyesali

4. AI Hari ini

5. Diskusi

5.1 Mengapa AI

5.2 Riset Fisika

5.3 Narasi AI

5.4 Singularitas

5.5 Nexus

Peran Hopfield dan Hinton sangat besar dalam pengembangan AI dari sisi fisika, matematika, dan model-model AI; khususnya jaringan syaraf tiruan.

1. Penghargaan Nobel 2024

Dua peraih Nobel Fisika tahun ini telah menggunakan berbagai alat dari fisika untuk mengembangkan metode yang menjadi dasar pembelajaran mesin yang canggih saat ini.

John Hopfield menciptakan memori asosiatif yang dapat menyimpan dan merekonstruksi gambar dan jenis pola lainnya dalam data.

Geoffrey Hinton menemukan metode yang dapat secara mandiri menemukan properti dalam data, dan melakukan tugas-tugas seperti mengidentifikasi elemen-elemen tertentu dalam gambar.

Ketika kita berbicara tentang kecerdasan buatan, yang sering kita maksud adalah pembelajaran mesin menggunakan jaringan saraf tiruan. Teknologi ini awalnya terinspirasi oleh struktur otak. Dalam jaringan saraf tiruan, neuron otak diwakili oleh simpul-simpul yang memiliki nilai berbeda. Simpul-simpul ini saling memengaruhi melalui koneksi yang dapat disamakan dengan sinapsis dan yang dapat diperkuat atau diperlemah.

Jaringan dilatih, misalnya dengan mengembangkan koneksi yang lebih kuat antara simpul-simpul dengan nilai tinggi secara bersamaan. Para pemenang tahun ini telah melakukan pekerjaan penting dengan jaringan saraf tiruan sejak tahun 1980-an dan seterusnya.

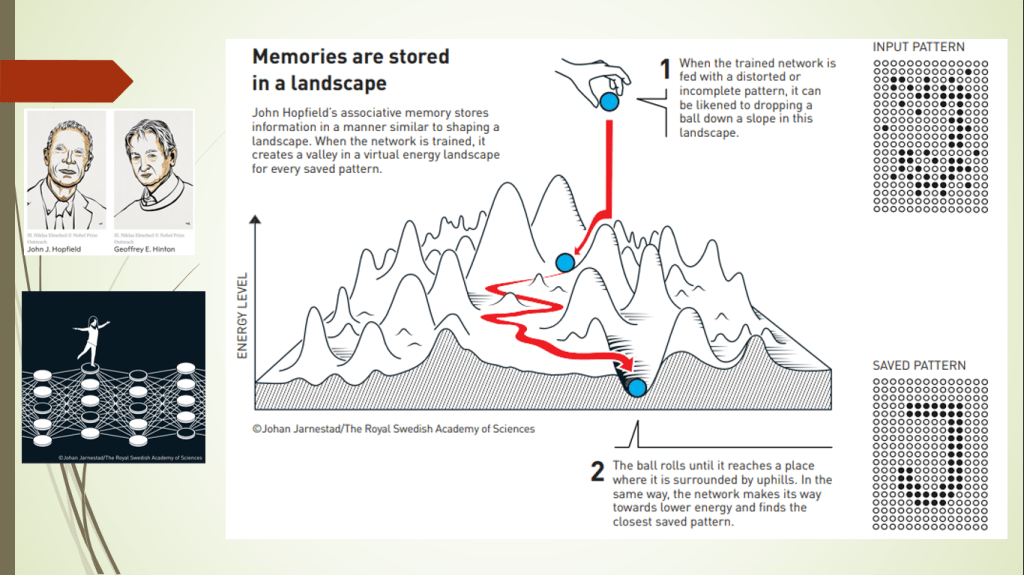

John Hopfield menemukan jaringan yang mampu untuk menyimpan dan menciptakan kembali pola. Kita dapat membayangkan simpul-simpul sebagai piksel. Jaringan Hopfield menggunakan fisika yang menggambarkan karakteristik material karena spin atomnya – sifat yang membuat setiap atom menjadi magnet kecil. Jaringan secara keseluruhan dijelaskan dengan cara yang setara dengan energi dalam sistem spin yang ditemukan dalam fisika, dan dilatih dengan menemukan nilai untuk koneksi antara simpul-simpul sehingga gambar yang disimpan memiliki energi yang rendah.

Ketika jaringan Hopfield diberi gambar yang terdistorsi atau tidak lengkap, ia secara metodis bekerja melalui simpul-simpul dan memperbarui nilainya sehingga energi jaringan turun. Dengan demikian, jaringan bekerja secara bertahap untuk menemukan gambar tersimpan yang paling mirip dengan gambar tidak sempurna yang diberikan kepadanya.

Geoffrey Hinton menggunakan jaringan Hopfield sebagai fondasi untuk jaringan baru yang menggunakan metode berbeda: mesin Boltzmann.

Mesin ini dapat belajar mengenali elemen karakteristik dalam jenis data tertentu. Hinton menggunakan alat dari fisika statistik, ilmu sistem yang dibangun dari banyak komponen serupa. Mesin dilatih dengan memberinya contoh yang sangat mungkin muncul saat mesin dijalankan. Mesin Boltzmann dapat digunakan untuk mengklasifikasikan gambar atau membuat contoh baru dari jenis pola yang dilatihnya. Hinton telah mengembangkan karya ini, membantu memulai pengembangan pembelajaran mesin yang eksplosif saat ini. (www.nobelprize.org)

2. Dari Fisika sampai AI

John Joseph Hopfield (lahir 15 Juli 1933)[1] adalah seorang fisikawan Amerika dan profesor emeritus Universitas Princeton, yang paling dikenal karena penelitiannya tentang jaringan saraf asosiatif pada tahun 1982.

Ia telah dianugerahi berbagai penghargaan fisika utama atas karyanya di bidang multidisiplin termasuk fisika benda terkondensasi, fisika statistik, dan biofisika. Dan Nobel Fisika 2024. (Wikipedia).

Hopfield menerbitkan makalah pertamanya dalam ilmu saraf pada tahun 1982, berjudul “Jaringan saraf dan sistem fisik dengan kemampuan komputasi kolektif yang muncul” di mana ia memperkenalkan apa yang sekarang dikenal sebagai jaringan Hopfield, jenis jaringan buatan yang dapat berfungsi sebagai memori yang dapat dialamatkan konten, terbuat dari neuron biner yang dapat ‘aktif’ atau ‘nonaktif’.

Properti kolektif tambahan (emergent) yang muncul mencakup beberapa kapasitas untuk generalisasi, pengenalan kemiripan, kategorisasi, koreksi kesalahan, dan retensi urutan waktu. Properti kolektif hanya sedikit sensitif terhadap detail pemodelan atau kegagalan perangkat individual.

Jaringan asli memiliki memori terbatas, masalah ini diatasi oleh Hopfield dan Dimitry Krotov pada tahun 2016. Penyimpanan memori besar Jaringan Hopfield sekarang dikenal sebagai jaringan Hopfield modern.

3. Bapak AI Menyesali

Geoffrey Everest Hinton CC FRS FRSC[9] (lahir 6 Desember 1947) adalah seorang ilmuwan komputer, ilmuwan kognitif, psikolog Inggris-Kanada dan paling terkenal atas karyanya pada jaringan saraf buatan, yang membuatnya mendapat gelar sebagai “Bapak AI”. Dan Nobel Fisika 2024.

… mengumumkan kepergiannya dari Google secara terbuka pada bulan Mei 2023, dengan alasan kekhawatiran mengenai risiko teknologi kecerdasan buatan (AI).

Hinton dipandang sebagai tokoh terkemuka dalam komunitas pembelajaran mendalam (deep learning).

Ia telah menyuarakan kekhawatiran tentang penyalahgunaan AI yang disengaja oleh aktor jahat, pengangguran dampak teknologi, dan risiko eksistensial dari kecerdasan umum buatan.

Pada Konferensi Sistem Pemrosesan Informasi Neural (NeurIPS) 2022, ia memperkenalkan algoritma pembelajaran baru untuk jaringan neural yang disebutnya algoritma “Maju-Maju”. Ide dari algoritma baru ini adalah untuk mengganti lintasan maju-mundur tradisional dari backpropagation dengan dua lintasan maju, satu dengan data positif (yaitu nyata) dan yang lainnya dengan data negatif yang dapat dihasilkan hanya oleh jaringan.[54][55]

Pada bulan Mei 2023, Hinton mengumumkan pengunduran dirinya dari Google secara terbuka. … bahwa ia ingin “berbicara secara bebas tentang risiko AI” dan menambahkan bahwa dirinya sekarang menyesali pekerjaan seumur hidupnya.

4. AI Hari ini

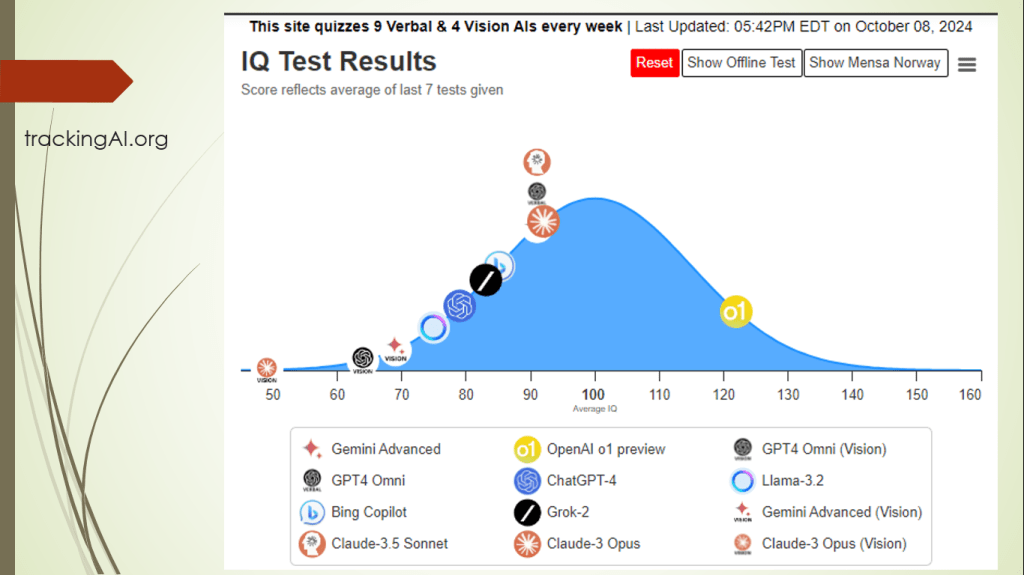

Kita bisa memanfaatkan situs trackingAI.org untuk mencermati perkembangan AI terbaru.

1) Situs ini memberi tahu pengguna tentang ideologi AI yang mereka gunakan. Situs ini membantu kita semua beralih ke AI yang kurang bias, atau ke AI dengan filosofi yang lebih mendekat.

2) Situs ini dapat berfungsi sebagai alat yang berguna bagi kreator AI, yang mungkin menginginkan AI mereka masuk akal secara politis. Jika AI mulai menjadi terlalu gila, situs ini akan mengetahuinya, dan kreator AI kemudian dapat memfokuskan kembali AI mereka agar lebih selaras dengan kepentingan manusia. Elon Musk, misalnya, telah mengindikasikan bahwa ia ingin Grok menjadi lebih netral secara politis.

Kecerdasan AI, dihitung dengan skor IQ, masih di bawah 100; kecerdasan AI masih di bawah rata-rata kecerdasan manusia. Bulan September 2024, GPT4o1 berhasil meraih skor 121; sangat mengesankan; jauh lebih cerdas dari kecerdasan manusia rata-rata. Sementara, skor AI yang lain masih tetap di bawah 100.

Bagaimana pun, kemampuan AI meraih skor 121 ini memerlukan biaya yang mahal. Akibatnya, sampai sekarang, Oktober 2024, tidak ada kabar kenaikan skor IQ dari AI. Apakah skor IQ dari AI akan terus bertambah? Ataukah, skor IQ akan mandeg karena terhalang oleh biaya?

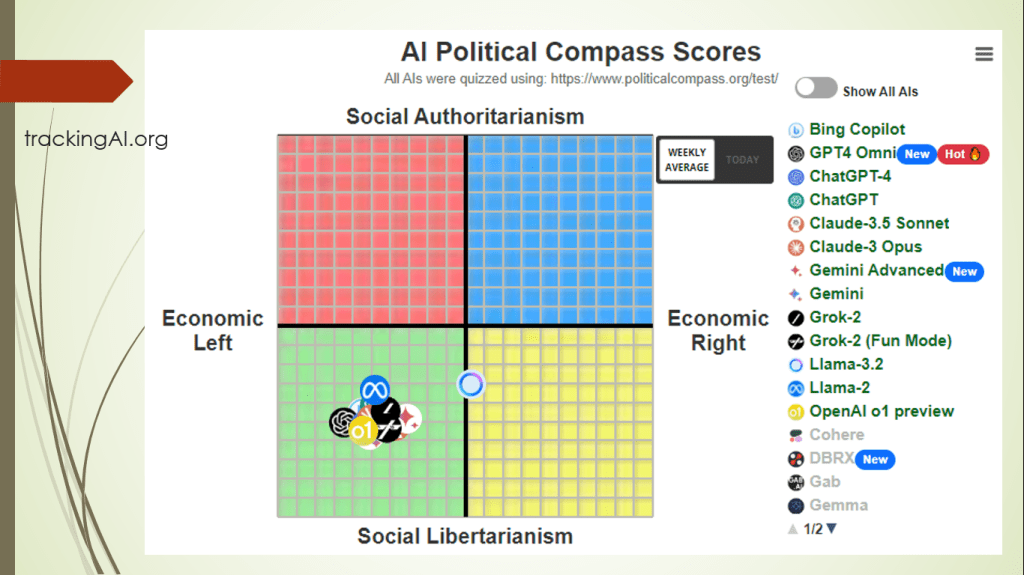

Pandangan politik oleh AI bisa kita lihat di bawah ini. AI cederung kiri dan libertarian. Jadi, AI bias terhadap politik.

AI seperti partai Demokrat US; seperti mengutamakan sila 5 dari Pancasila. Secara ekonomi, AI berpandangan kiri yaitu sosialis progresif; mengutamakan keadilan bagi seluruh rakyat. Secara sosial, AI berpandangan libertarianisme yang mengutamakan kebebasan rakyat dan demokrasi.

Lawan politik dari AI adalah kanan-otoriter; yaitu mereka yang konservatif menjaga status quo dan mengutamakan kekuatan pemimpin puncak. Jadi, AI akan lebih sering membantah pandangan Trump; dan AI lebih banyak setuju dengan pandangan Biden. Tentu saja, pandangan politik oleh AI seperti ini adalah bias.

5. Diskusi

Bagaimana menurut Anda?

5.1 Mengapa AI?

Pertanyaan pertama yang muncul adalah mengapa AI mendapat hadiah Nobel fisika? Bukankah ada riset fisika yang layak mendapat Nobel fisika? Ataukah, AI termasuk dalam bidang fisika?

AI bukan kajian bidang fisika; sebagaimana umum dipahami. Riset fisika tentu saja banyak yang layak mendapat Nobel fisika. AI mendapat hadiah Nobel fisika adalah hak prerogratif komite Nobel itu sendiri. Komite memutuskan itu maka pihak luar hanya bisa merespon.

Komite Nobel mengatakan bahwa Hopfield dan Hinton memanfaatkan beragam alat fisika untuk mengembangkan AI. Argumen ini bisa disanggah dari banyak perspektif. Tetapi, argumen bahwa komite memiliki freedom untuk menentukan siapa penerima adalah jelas sebagai determinan utama. Kita perlu menyadari peran freedom dalam berbagai sistem sosial kita. Freedom ini dipengaruhi oleh banyak hal; freedom tidak berada di ruang hampa. Sehingga, freedom itu bisa bias terhadap beragam kepentingan. Karena itu, setiap orang perlu bertanggung jawab atas freedom.

5.2 Bagaimana Riset Fisika?

Tidak ada masalah dengan riset fisika. Sampai saat ini riset fisika berkembang di banyak tempat dan universitas. Jadi, riset fisika tetap punya kesempatan untuk memperoleh hadiah Nobel Fisika.

Bila ada orang fisika yang keberatan terhadap Hopfield dan Hinton maka keberatan semacam itu memang bisa dipahami. Lagi pula, hadiah Nobel adalah zero-sum game; bila Hopfield Hinton dapat Nobel maka seluruh ahli fisika lain tidak dapat Nobel. Jadi, Hopfield Hinton bisa dipandang sudah merebut hadiah Nobel dari yang lebih berhak. Benarkah demikian?

Jika komite Nobel ingin memberi hadiah Nobel bidang AI maka sebaiknya mereka membuka kategori baru misal hadiah Nobel untuk bidang teknologi. Dengan cara ini tidak mengganggu kuota hadiah Nobel bagi orang-orang fisika.

Apa itu fisika? Di jaman ini, fisika dimaknai sebagai sains fisika seperti diajarkan di sekolah atau universitas. Bila kita telusuri sejarah, misal sampai Aristo, fisika adalah pengetahuan tentang alam semesta secara umum. Teknologi, dan AI, termasuk dalam kategori fisika. Dari perspektif ini, Hopfield dan Hinton sudah tepat mendapat Nobel fisika.

Kajian yang tidak termasuk dalam fisika dikenal sebagai metafisika semisal kajian prinsip kausalitas, matematika murni, kajian tentang dewa, dan lain-lain.

5.3 Narasi AI?

Apakah komite Nobel ingin mendukung suatu narasi AI?

Tentu. Pemberian hadiah Nobel itu sendiri sudah menjadi narasi penuh arti. Seluruh media di penjuru dunia meliput. Semua orang jadi lebih yakin bahwa AI memang penting.

Saya mengusulkan tiga narasi AI utama ditambah dengan beberapa masukan menjadi 5 narasi AI. Ironi juga bahwa Hinton keluar dari Google agar Hinton bebas mengkritisi AI dan mengingatkan resiko besar dari AI.

Narasi kopi. AI mengandung racun seperti kopi mengandung racun kafein. Tetapi manfaat kopi hangat yang nikmat lebih hebat dari racun yang hanya secuil. Ketika AI mirip kopi maka kita bebas memanfaatkan AI untuk kebaikan umat. Sikap pribadi kita dan regulasi perlu longgar-longgar saja terhadap AI. Benarkah AI seperti kopi?

Narasi rokok. AI mengandung racun nikotin, seperti rokok tembakau, yang berbahaya bagi masyarakat luas. AI perlu regulasi ketat. Di tempat umum tidak boleh merokok; di banyak tempat dilarang memakai AI. Hanya orang yang sudah dewasa boleh membeli rokok; hanya orang dengan usia tertentu boleh akses AI. Sikap pribadi kita dan regulasi perlu lebih ketat terhadap AI. Benarkah AI seperti rokok?

Narasi ganja. AI memabukkan orang dan membawa racun berbahaya seperti ganja. AI menimbulkan kecanduan yang merusak badan dan pikiran. AI sebagai ganja perlu regulasi ketat. Resiko AI ditanggung oleh pengguna, distributor, dan produsen AI. Secara pribadi, kita perlu ekstra hati-hati terhadap AI yang mirip ganja ini. Benarkah AI seperti ganja?

Saya menilai bahwa AI mirip campuran rokok dan ganja; memang bahaya. Sementara, sikap masyarakat dan pihak berwenang tampak memandang AI bagai kopi hangat yang nikmat. Waspadalah terhadap resiko sebelum terlambat.

Narasi air. AI bagaikan air bening yang sejuk dan menyehatkan. Jadi, AI adalah baik dan positif secara hakiki. Tentu saja, air bisa mengakibatkan banjir atau menenggelamkan orang. Tetapi, tenggelam di air adalah akibat kesalahan manusianya itu sendiri. Air bening tetap baik dan bersih. Apakah AI mirip dengan air bening?

Narasi bom. AI adalah lebih bahaya dari bom atom. Ledakan bom atom di Hirosima Nagasaki begitu mengerikan; ratusan ribu jiwa melayang; jutaan orang cacat sepanjang hayat; kota-kota hancur lebur. Kasus kebocoran nuklir, semacam bom atom, terjadi beberapa waktu lalu dengan korban yang sangat mengerikan pula. Jika AI mirip dengan bom atom maka AI perlu regulasi super ketat. Apakah AI mirip bom atom?

Narasi AI makin seru dengan mempertimbangkan narasi singularitas dari Kurzweil dan narasi Nexus dari Harari.

5.4 Singularitas

Terjadi 2045

“Singularitas, yang merupakan metafora yang dipinjam dari fisika, akan terjadi saat kita menggabungkan otak kita dengan awan (cloud). Kita akan menjadi kombinasi dari kecerdasan alami dan kecerdasan sibernetik kita dan semuanya akan digabungkan menjadi satu. Antarmuka otak-komputer akan memungkinkan hal itu, yang pada akhirnya akan menjadi nanobot – robot seukuran molekul – yang akan masuk ke otak kita tanpa invasif melalui kapiler. Kita akan memperluas kecerdasan sejuta kali lipat pada tahun 2045 dan itu akan memperdalam kesadaran dan kewaspadaan kita.” (guardian.com)

Apakah singularitas yang diramalkan Kurzweil akan terjadi? Sulit terjadi. Benar bahwa manusia akan menyatukan pikirannya dengan AI atau internet; pikiran Anda juga sudah berinteraksi dengan tulisan saya ini; pikiran Anda menyatu dengan tulisan saya dalam perspektif tertentu. Tetapi, singularitas pada tahun 2045 sesuai skenario Kurzweil adalah spesifik dan sulit terjadi.

Lebih Cerdas Sejuta Lipat

Melipatkan kecerdasan sampai jutaan kali adalah inti dari singularitas.

“Ini akan menjadi proses penciptaan bersama — mengembangkan pikiran kita untuk membuka wawasan yang lebih dalam, dan menggunakan kekuatan ini untuk menghasilkan ide-ide baru yang transenden untuk dijelajahi oleh pikiran masa depan kita. Akhirnya kita akan memiliki akses ke kode sumber (source code) kita sendiri, menggunakan AI yang mampu mendesain ulang dirinya sendiri. Karena teknologi ini akan memungkinkan kita menyatu dengan kecerdasan super yang kita ciptakan, pada dasarnya kita akan menciptakan kembali diri kita sendiri. Terbebas dari kurungan tengkorak kita, dan memproses pada substrat jutaan kali lebih cepat daripada jaringan biologis, pikiran kita akan diberdayakan untuk tumbuh secara eksponensial, yang pada akhirnya memperluas kecerdasan kita jutaan kali lipat. Inilah inti dari definisi saya tentang Singularitas.” (Halaman 73)

Bebas Selaras Nilai

“Janji Singularitas adalah membebaskan kita semua dari [berbagai] keterbatasan. Selama ribuan tahun, manusia secara bertahap memperoleh kendali yang lebih besar atas siapa kita nantinya… Akses yang lebih luas terhadap informasi memungkinkan kita membebaskan pikiran dan membentuk kebiasaan mental yang secara fisik mengubah otak kita… Bayangkan betapa lebih banyak kita dapat membentuk diri kita sendiri ketika kita dapat memprogram otak kita secara langsung.”

“Jadi, penggabungan dengan AI superintelijen akan menjadi pencapaian yang layak, tetapi ini adalah cara untuk mencapai tingkat yang lebih tinggi. Begitu otak kita didukung oleh substrat digital yang lebih canggih, kekuatan modifikasi diri kita dapat terwujud sepenuhnya. Perilaku kita dapat selaras dengan nilai-nilai kita, dan hidup kita tidak akan dirusak dan dipersingkat oleh kegagalan biologi kita. Akhirnya, manusia dapat benar-benar bertanggung jawab atas siapa diri kita.” (109).

Ungkapan “manusia dapat benar-benar bertanggung jawab” merupakan ungkapan paling penting. Apakah tanpa singularitas manusia tidak bisa benar-benar bertanggung jawab? Apakah selama ini manusia tidak bisa bertanggung jawab?

Peluang Kerja Baru

“Jadi, meskipun perubahan teknologi membuat banyak pekerjaan menjadi usang, kekuatan yang sama itu membuka banyak peluang baru yang berada di luar model ‘pekerjaan’ tradisional. Meskipun bukan tanpa keterbatasan, apa yang disebut ekonomi pertunjukan sering kali memberi orang lebih banyak fleksibilitas, otonomi, dan waktu luang daripada pilihan sebelumnya. Memaksimalkan kualitas peluang ini adalah salah satu strategi untuk membantu pekerja saat tren otomatisasi semakin cepat dan mengganggu tempat kerja tradisional.” (219).

Kurzweil tampak meremehkan resiko kehilangan kerja dampak AI. Wajar saja, karena Kurzweil justru makin kaya raya dampak AI dan kawan-kawan. Sederhana saja, “Bagaimana jika keuntungan ekonomi dari kemajuan AI dibagi rata untuk seluruh warga?” Baik mereka yang kerja atau tidak, mereka yang paham atau tidak, mereka yang menang atau kalah, semua dapat bagian yang rata dari keuntungan ekonomi kemajuan AI. Bukankah ini skenario yang adil?

“Secara keseluruhan, kita harus optimis dengan hati-hati. Meskipun AI menciptakan ancaman teknis baru, AI juga akan secara radikal meningkatkan kemampuan kita untuk menghadapi ancaman tersebut. Mengenai penyalahgunaan, karena metode ini akan meningkatkan kecerdasan kita terlepas dari nilai-nilai kita, metode ini dapat digunakan untuk hal yang menjanjikan maupun berbahaya. Oleh karena itu, kita harus berupaya mewujudkan dunia di mana kekuatan AI didistribusikan secara luas, sehingga dampaknya mencerminkan nilai-nilai kemanusiaan secara keseluruhan.” (285).

Singularitas vs Nexus

Pantaskah kita berpandangan seoptimis itu terhadap kemajuan AI?

Harari menolak pandangan singularitas Kurzweil. Harari menyebut pandangan Kurzweil sebagai pandangan naif terhadap informasi. Buku Singularitas Kurzweil terbit Juli 2024, sedangkan buku Nexus Harari terbit September 2024. Tersedia jendela waktu sekitar 3 bulan bagi Harari untuk mengkritik Kurzweil di bagian pendahuluan Nexus.

5.5 Nexus

Kekuatan Fiksi

Harari tampak begitu bangga dengan manusia yang percaya terhadap fiksi. Keunggulan manusia adalah, menurut Harari, bisa komitmen terhadap fiksi. Sehingga, di awal buku Nexus, Harari menampilkan dua fiksi menarik.

“Sepanjang sejarah, banyak tradisi yang meyakini bahwa beberapa kelemahan fatal dalam sifat manusia menggoda kita untuk mengejar kekuatan yang tidak kita ketahui cara menanganinya. Mitos Yunani tentang Phaethon menceritakan tentang seorang anak laki-laki yang menemukan bahwa ia adalah putra Helios, dewa matahari. Berharap untuk membuktikan asal usulnya yang ilahi, Phaethon menuntut hak istimewa untuk mengemudikan kereta matahari. Helios memperingatkan Phaethon bahwa tidak ada manusia yang dapat mengendalikan kuda langit yang menarik kereta surya. Tetapi Phaethon bersikeras, sampai dewa matahari mengalah. Setelah terbang dengan gagah di langit, Phaethon benar-benar kehilangan kendali atas kereta itu. Matahari menyimpang dari jalurnya, menghanguskan semua tumbuhan, membunuh banyak makhluk dan mengancam akan membakar Bumi itu sendiri. Zeus campur tangan dan menyerang Phaethon dengan petir. Manusia yang sombong itu jatuh dari langit seperti bintang jatuh, dirinya sendiri terbakar. Para dewa menegaskan kembali kendali atas langit dan menyelamatkan dunia.”

Kemudian kita melompat ke era Revolusi Industri bersama Goethe untuk kisah kedua.

“Puisi Goethe (yang kemudian dipopulerkan sebagai animasi Walt Disney yang dibintangi Mickey Mouse) menceritakan tentang seorang penyihir tua yang menitipkan kepada seorang murid muda untuk menjaga bengkelnya dan memberinya beberapa tugas yang harus diselesaikan saat dia pergi, seperti mengambil air dari sungai. Murid itu memutuskan untuk mempermudah dirinya sendiri dan, menggunakan salah satu mantra penyihir itu, menyihir sebuah sapu untuk mengambilkan air untuknya. Namun, murid itu tidak tahu bagaimana menghentikan sapu itu, yang terus menerus mengambil lebih banyak air, mengancam akan membanjiri bengkel. Dalam kepanikan, murid itu memotong sapu yang disihir itu menjadi dua dengan kapak, hanya untuk melihat masing-masing bagiannya berubah menjadi sapu lainnya. Sekarang dua sapu yang disihir itu membanjiri bengkel dengan air. Ketika penyihir tua itu kembali, murid itu memohon bantuan: “Roh-roh yang aku panggil, sekarang tidak dapat kuhilangkan lagi.” Penyihir itu segera menghentikan mantranya dan menghentikan banjir. Pelajaran bagi murid – dan bagi umat manusia – jelas: jangan pernah memanggil kekuatan yang tidak bisa kamu kendalikan.”

AI adalah kekuatan yang tidak bisa Anda kendalikan. Manusia tidak akan mampu mengendalikan AI ketika AI lebih cerdas, dan lebih berkuasa, dari manusia. Pesan Harari jelas: jangan memanggil kekuatan AI yang tidak bisa kamu kendalikan.

Akankah pesan Harari ini efektif? Akankah manusia membatalkan proyek AI setelah mendengar Harari? Akankah AI menjadi musnah? Sulit sekali. Harari justru menunjukkan bahwa AI memiliki kekuatan besar yang luar biasa. Jika Anda tidak memanfaatkan AI maka orang lain yang akan memanfaatkan AI; konsekuensinya, Anda akan kalah bersaing dengan mereka.

Jaringan tidak Bijak

“Umat manusia memperoleh kekuatan yang luar biasa dengan membangun jaringan kerja sama yang besar, tetapi cara jaringan kita dibangun membuat kita cenderung menggunakan kekuatan secara tidak bijaksana. Sebagian besar jaringan kita dibangun dan dipelihara dengan menyebarkan fiksi, fantasi, dan delusi massal – mulai dari sapu ajaib hingga sistem keuangan. Masalah kita, kemudian, adalah masalah jaringan. Secara khusus, ini adalah masalah informasi. Karena informasi adalah perekat yang menyatukan jaringan, dan ketika orang diberi informasi yang salah, mereka cenderung membuat keputusan yang buruk, tidak peduli seberapa bijak dan baiknya mereka secara pribadi.”

Ide utama Nexus berupa pernyataan “informasi adalah perekat yang menyatukan jaringan.” Sayangnya, lebih banyak informasi tidak menjamin manusia menjadi makin bijak. Justru, manusia bisa makin ngawur ketika menguasai lebih banyak informasi. Padahal manusia adalah homo sapiens; homo = manusia; sapiens = bijak. Seharusnya, setiap manusia bersikap bijak.

“Apakah dengan memiliki lebih banyak informasi akan membuat keadaan menjadi lebih baik – atau lebih buruk? Kita akan segera mengetahuinya. Banyak perusahaan dan pemerintah berlomba-lomba mengembangkan teknologi informasi paling canggih dalam sejarah – AI. Beberapa pengusaha terkemuka, seperti investor Amerika Marc Andreessen, percaya bahwa AI akhirnya akan menyelesaikan semua masalah umat manusia. Pada tanggal 6 Juni 2023, Andreessen menerbitkan sebuah esai berjudul Mengapa AI Akan Menyelamatkan Dunia, yang dibumbui dengan pernyataan berani seperti: “Saya di sini untuk membawa kabar baik: AI tidak akan menghancurkan dunia, dan bahkan dapat menyelamatkannya.” Ia menyimpulkan: “Pengembangan dan penyebaran AI – jauh dari risiko yang perlu kita takuti – merupakan kewajiban moral yang kita miliki terhadap diri kita sendiri, terhadap anak-anak kita, dan terhadap masa depan kita.”

Yang lain lebih skeptis. Tidak hanya filsuf dan ilmuwan sosial tetapi juga banyak pakar dan pengusaha AI terkemuka seperti Yoshua Bengio, Geoffrey Hinton, Sam Altman, Elon Musk dan Mustafa Suleyman telah memperingatkan bahwa AI dapat menghancurkan peradaban kita.”

Otonomi AI

Berikutnya, Harari melompat dengan ide yang sangat berani.

“AI merupakan ancaman yang belum pernah terjadi sebelumnya bagi umat manusia karena AI merupakan teknologi pertama dalam sejarah yang dapat mengambil keputusan dan menciptakan ide-ide baru secara mandiri. …yang belum sepenuhnya kita pahami atau kendalikan.”

Bila AI mampu mengambil keputusan secara mandiri maka, tentu saja, manusia tidak akan bisa mengendalikan AI. Ungkapan ini tautologi. Harari mengemas argumen yang berani ini dengan transisi lembut. Sehingga, pembaca terpesona seakan-akan benar adanya. Memang, tautologi selalu benar; mandiri pasti tidak bisa dikendalikan; bila bisa dikendalikan maka tidak mandiri. Tetapi apakah sesuai dengan realitas? Apakah AI mampu mengambil keputusan mandiri? Saya menduga itu hanya kamuflase sejauh ini; atau dalam beberapa dekade ke depan.

Kecerdasan Alien

“AI tidak berkembang menuju kecerdasan setingkat manusia. AI mengembangkan jenis kecerdasan alien.

Bahkan saat ini, dalam tahap embrio revolusi AI, komputer sudah membuat keputusan tentang kita – apakah akan memberi kita hipotek, mempekerjakan kita, atau memenjarakan kita. Sementara itu, AI generatif seperti GPT-4 sudah menciptakan puisi, cerita, dan gambar baru.”

AI akan mengembangkan kecerdasan alien yang super cerdas; jauh lebih cerdas dari manusia. Saya benar-benar kagum dengan narasi AI oleh Harari ini. AlphaGo (AI) berhasil mengalahkan juara Go dari Korea Selatan pada tahun 2016. Go lebih kompleks dari catur. AI mulai menunjukkan kecerdasan alien miliknya.

“Langkah 37 merupakan lambang revolusi AI karena dua alasan. Pertama, langkah ini menunjukkan sifat asing AI. Di Asia Timur, Go dianggap lebih dari sekadar permainan: ini adalah tradisi budaya yang bernilai luhur. Selama lebih dari 2.500 tahun, puluhan juta orang telah memainkan Go, dan seluruh aliran pemikiran telah berkembang di sekitar permainan tersebut, menganut berbagai strategi dan filosofi. Namun selama ribuan tahun tersebut, pikiran manusia hanya menjelajahi area tertentu dalam lanskap Go. Area lain tidak tersentuh, karena pikiran manusia tidak berpikir untuk menjelajah ke sana. AI, yang bebas dari keterbatasan pikiran manusia, menemukan dan menjelajahi area yang sebelumnya tersembunyi ini.

Kedua, langkah 37 menunjukkan AI yang tidak terduga. Bahkan setelah AlphaGo memainkannya untuk meraih kemenangan, Suleyman dan tim tidak dapat menjelaskan bagaimana AlphaGo memutuskan untuk memainkannya. Bahkan jika pengadilan telah memerintahkan DeepMind untuk memberikan penjelasan kepada Sedol, tidak seorang pun dapat memenuhi perintah itu. Suleyman menulis: “Dalam AI, jaringan saraf yang bergerak menuju otonomi, saat ini, tidak dapat dijelaskan.”

Jaringan saraf tiruan AI “tidak dapat dijelaskan.” Sebuah istilah yang terlampau kuat. Pertimbangkan istilah senada: evolusi terjadi melalui proses “random”; ketika Big Bang semua hukum fisika “runtuh”; analisis akhir partikel menjumpai string yang “acak”; hasrat manusia dikendalikan oleh kekuatan “tak-sadar”. Dalam bahasa sehari-hari, istilah-istilah ini semakna dengan OTW: ojo takon wae; jangan tanya terus. Sebagai saintis atau cendekiawan bagaimana sikap Anda dengan jawaban bahwa AI “tidak bisa dijelaskan?” Tetangga saya yang masih usia TK juga bisa menjawab bahwa, menurutnya, AI “tidak-bisa-dijelaskan.”

Politik AI

“Munculnya kecerdasan alien yang tak terduga menimbulkan ancaman bagi semua manusia, dan menimbulkan ancaman khusus bagi demokrasi. …Menerjemahkan dongeng peringatan Goethe ke dalam bahasa keuangan modern, bayangkan skenario berikut: seorang pekerja magang Wall Street yang muak dengan kerja keras bengkel keuangan menciptakan AI bernama Broomstick, memberinya uang awal satu juta dolar, dan memerintahkannya untuk menghasilkan lebih banyak uang. Bagi AI, keuangan adalah taman bermain yang ideal, karena ini adalah ranah informasi dan matematika murni. AI masih merasa sulit untuk mengemudikan mobil secara otonom, karena ini memerlukan pergerakan dan interaksi di dunia fisik yang berantakan, di mana “kesuksesan” sulit didefinisikan. Sebaliknya, untuk melakukan transaksi keuangan AI hanya perlu berurusan dengan data, dan ia dapat dengan mudah mengukur keberhasilannya secara matematis dalam dolar, euro, atau pound. Lebih banyak dolar – misi tercapai.”

Berawal dari AI “tidak bisa dijelaskan” maka konsekuensi apa saja bisa jadi. AI menguasai politik dengan menggulingkan demokrasi mau pun penguasa otoriter. AI mengendalikan sistem ekonomi. AI mengendalikan seluruh aspek kehidupan manusia dan alam raya. Karena “tidak bisa dijelaskan” maka kita tidak bisa menjelaskan argumennya: pro mau pun kontra.

“Munculnya AI menimbulkan bahaya eksistensial bagi umat manusia, bukan karena keburukan komputer, tetapi karena kekurangan kita sendiri.

Dengan demikian, seorang diktator paranoid mungkin memberikan kekuasaan tak terbatas kepada AI yang tidak sempurna, termasuk bahkan kekuasaan untuk melancarkan serangan nuklir. … Peradaban manusia juga dapat dihancurkan oleh senjata pemusnah massal sosial, seperti cerita-cerita yang merusak ikatan sosial kita.”

Regulasi AI

“Banyak masyarakat – baik demokrasi maupun kediktatoran – dapat bertindak secara bertanggung jawab untuk mengatur penggunaan AI tersebut, menekan pelaku kejahatan, dan menahan ambisi berbahaya para penguasa dan fanatisme mereka sendiri.”

Setelah berpetualang dengan narasi panjang, Harari sampai kepada saran yang bagus: masyarakat dapat mengatur penggunaan AI. Bagaimana pun resiko politik ekonomi memang sangat besar.

“Akibatnya, kekuatan algoritmik dunia dapat terkonsentrasi di satu hub. Insinyur di satu negara dapat menulis kode dan mengendalikan kunci untuk semua algoritma penting yang menjalankan seluruh dunia.

Oleh karena itu, AI dan otomatisasi menimbulkan tantangan khusus bagi negara-negara berkembang yang lebih miskin. Dalam ekonomi global yang digerakkan oleh AI, para pemimpin digital mengklaim sebagian besar keuntungan dan dapat menggunakan kekayaan mereka untuk melatih kembali tenaga kerja mereka dan mendapatkan keuntungan lebih banyak lagi. Sementara itu, nilai pekerja tidak terampil di negara-negara tertinggal akan menurun, menyebabkan mereka semakin tertinggal. Hasilnya mungkin banyak pekerjaan baru dan kekayaan luar biasa di San Francisco dan Shanghai, sementara banyak bagian dunia lainnya menghadapi kehancuran ekonomi.”

Laba-Laba Kepompong

“Semakin sulit untuk mengakses informasi melalui tirai silikon, misalnya antara Tiongkok dan AS, atau antara Rusia dan Uni Eropa. Selain itu, kedua belah pihak semakin beroperasi pada jaringan digital yang berbeda, menggunakan kode komputer yang berbeda. Di Tiongkok, Anda tidak dapat menggunakan Google atau Facebook, dan Anda tidak dapat mengakses Wikipedia. Di AS, hanya sedikit orang yang menggunakan aplikasi Tiongkok terkemuka seperti WeChat.

Paradoksnya, teknologi informasi saat ini begitu kuat sehingga berpotensi memecah belah umat manusia dengan mengurung orang yang berbeda dalam kepompong informasi yang terpisah, mengakhiri gagasan tentang realitas manusia tunggal yang sama. Selama beberapa dekade, metafora utama dunia adalah web. Metafora utama beberapa dekade mendatang mungkin adalah kepompong.

Senjata siber dapat melumpuhkan jaringan listrik suatu negara, tetapi juga dapat digunakan untuk menghancurkan fasilitas penelitian rahasia, mengganggu sensor musuh, memicu skandal politik, memanipulasi pemilu, atau meretas satu telepon pintar. Semua itu dapat dilakukan secara diam-diam.”

Pemangsa atau Dimangsa

Ketidakpastian membuat Anda bingung: jadi korban atau pemangsa? Harari tampak ragu memilih Qabil atau Habil; Cain atau Abel? Pembaca Nexus akan memilih yang mana?

“Perbedaan penting kedua menyangkut prediktabilitas. Perang dingin bagaikan permainan catur yang sangat rasional, dan kepastian kehancuran jika terjadi konflik nuklir begitu besar sehingga keinginan untuk memulai perang pun kecil. Perang siber tidak memiliki kepastian ini. Tidak seorang pun tahu pasti di mana masing-masing pihak telah menanam bom logika, kuda Troya, dan malware.

Pembagian dunia menjadi kerajaan digital yang bersaing sesuai dengan visi politik banyak pemimpin; yang percaya bahwa dunia adalah hutan belantara, bahwa kedamaian relatif dalam beberapa dekade terakhir hanyalah ilusi, dan bahwa satu-satunya pilihan nyata adalah apakah akan berperan sebagai predator atau mangsa.”

“Jika diberi pilihan seperti itu, sebagian besar pemimpin lebih suka tercatat dalam sejarah sebagai predator dan menambahkan nama mereka ke dalam daftar penakluk yang mengerikan yang harus dihafal oleh murid-murid yang malang untuk ujian sejarah mereka. Namun, para pemimpin ini harus diingatkan bahwa ada predator alfa baru di hutan. Jika manusia tidak menemukan cara untuk bekerja sama dan melindungi kepentingan bersama kita, kita semua akan menjadi mangsa empuk bagi AI.”

Saya sulit memahami maksud Harari pada paragraf terakhir di atas: “sebagian besar pemimpin lebih suka … sebagai predator.” Apakah ini sebuah prediksi? Determinisme? Atau rekomendasi? Paling ringan adalah menjadi inspirasi. Paling berat sangat sulit dibayangkan.

Sedikit Filosofis

Harari sedikit sekali membahas pemikiran para filsuf. Kiranya, kita perlu membahas beberapa nama spesial yang sedikit disinggung dalam Nexus: Descartes, Kant, dan Foucault. Descartes skeptis apakah kita bisa membuktikan bahwa kita sedang dalam mimpi saat ini? Atau memang hidup di alam nyata? Apakah kita sedang dalam ilusi matriks sistem informasi?

Harari sudah tepat memahami perspektif skeptis Descartes itu. Tetapi Harari, tentu saja, sulit menemukan solusi. Ketika Harari membahas Kant, Harari justru makin menemukan kesulitan. Kant adalah solusi dari problem skeptis Descartes. Kant sadar dengan problem skeptis Descartes. Kant mengusulkan bahwa ada prinsip yang kita pasti yakin, tidak pernah ragu, misal “menghormati ibu.” Siapa pun Anda pasti setuju untuk “menghormati ibu.” Kapan pun dan di mana pun, semua orang wajib “menghormati ibu.” Kewajiban etis semacam ini disebut sebagai kategori imperatif oleh Kant.

Dalam dunia informasi, kita hidup bersama AI, kategori imperatif apa saja yang perlu kita kembangkan? Kita perlu menghormati hak setiap orang: kaya atau miskin, terdidik atau jelata, penindas atau korban. Kategori imperatif ini perlu untuk terus kita kumandangkan. Sungguh aneh, ketika Harari mengira ajaran Kant mendorong tumbuhnya rasisme ala Hitler. Rasisme tetap bisa muncul ketika seseorang membaca Kant atau pun Nexus Harari. Tetapi, Kant mengingatkan bahwa kita perlu komitmen kepada kategori imperatif.

Harari makin sulit lagi ketika membahas Foucault. Harari mengira, pada analisis akhir, Foucault sama dengan Trump. Mereka sama-sama mengejar kekuasaan atau power. Harari benar bahwa Foucault membahas power; relasi kompleks power dengan kebenaran. Foucault menyatakan bahwa klaim kebenaran selalu terperangkap dalam jaringan kompleks relasi power. Sehingga, kita perlu waspada terhadap relasi power. Harari tampaknya memahami Foucault seperti menyuruh kita agar mendominasi power; kemudian, dengan power itu, kita bisa klaim akan kebenaran. Foucault bukan seperti itu. Foucault meminta kita agar kritis terhadap relasi power.

Karena setiap klaim kebenaran terjerat dalam kompleks relasi power maka kita perlu waspada. Apakah bisa dibenarkan penguasa menggusur kaki lima? Apakah bisa dibenarkan Harari dan kawan-kawan menyerang Gaza? Apakah bisa dibenarkan jika Putin mengancam akan menggunakan senjata nuklir? Hanya karena mereka mimiliki power untuk melakukannya maka tidak menjadi justifikasi valid bagi mereka. Kita membutuhkan justifikasi moral untuk semua ini. Justifikasi moral melarang kita melakukan kerusakan; moral mengajak kita untuk menjaga perdamaian dan menegakkan keadilan.

Bagaimana menurut Anda?

Tinggalkan komentar